课题组刘婧逸博士一篇论文被人工智能顶刊Neural Networks录用

时间:2023-07-11近日,课题组2021级博士研究生刘婧逸的学术论文《SNR: Symbolic Network-based Rectifiable Learning Framework for Symbolic Regression》被人工智能顶级期刊Neural Networks录用。《Neural Networks》是世界上三个最古老的神经建模学会的档案期刊:国际神经网络学会(INNS)、欧洲神经网络学会(ENNS)和日本神经网络学会(JNNS),中科院分区一区,WOS分区一区。

论文《SNR: Symbolic Network-based Rectifiable Learning Framework for Symbolic Regression》的第一作者为2021级博士研究生刘婧逸,通讯作者为李卫军研究员和于丽娜高级工程师。

Symbolic regression (SR)是一种用于揭示描述给定观测数据的潜在数学表达式的方法。目前,SR可以分为两种方法:从零开始学习(learning-from-scratch)和经验学习(learning-with-experience)。与从零开始学习相比,经验学习的结果与多个基准方法相当,并且获得表达式的时间成本显著较低。然而,经验学习模型在处理未见过的数据分布方面表现不佳,并且缺乏纠正工具,除了常数优化外,其性能有限。在本研究中,我们提出了一种具有纠正能力的符号回归学习框架,称为SNR(Symbolic Network-based Rectifiable Learning Framework)。

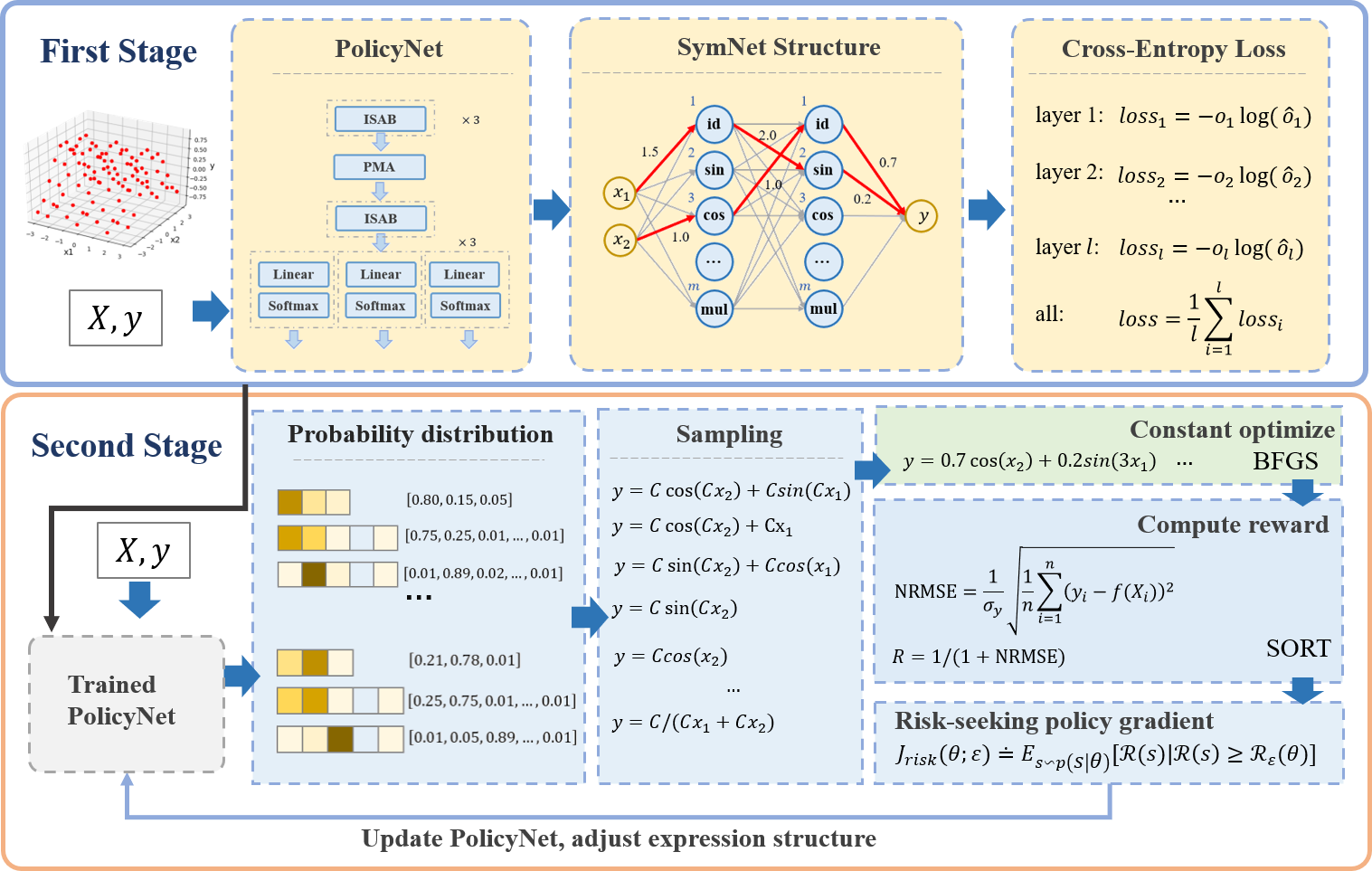

本文模型学习框架图

SNR采用SymbolicNetwork(SymNet)来表示表达式,并设计了SymNet的编码以提供监督信息,包括许多自动生成的表达式,用于训练策略网络(PolicyNet)。PolicyNet的训练可以提供先验知识,以引导有效的搜索。随后,通过纠正机制修正错误预测的表达式。这个纠正机制赋予了SNR更广泛的适用性。实验结果表明,与其他最先进的方法相比,我们提出的方法在自动生成的数据集上达到了最高的平均决定系数,并在公共数据集上产生更准确的结果。

这项研究的成果为符号回归问题提供了一种具有纠正能力的学习框架。SNR框架通过引入Symbolic Network和纠正机制,克服了经验学习模型的局限性,提高了回归结果的准确性和适用性。这一创新性的方法对于解决实际问题具有重要意义。